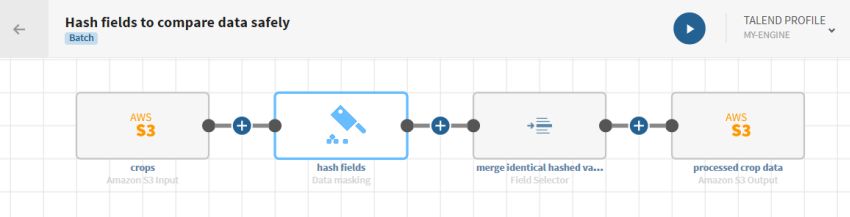

フィールドをハッシュしてデータを安全に比較

始める前に

-

ソースデータを保管するシステムへの接続が作成済みであること。

ここでは、Amazon S3接続を使用します。

-

ソースデータを保管するデータセットが追加済みであること。

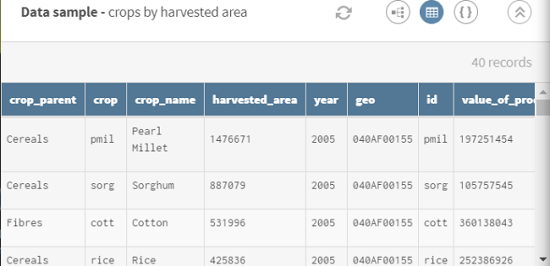

string-crops.csvファイルをダウンロードします。マリで収穫された作物に関するデータ(作物の種類、生産額、収穫面積など)を持つセットが含まれています。

-

接続および処理済みデータを保管する関連データセットも作成済みであること。

ここでは、同じS3バケットに保存されているデータセットを使用します。

手順

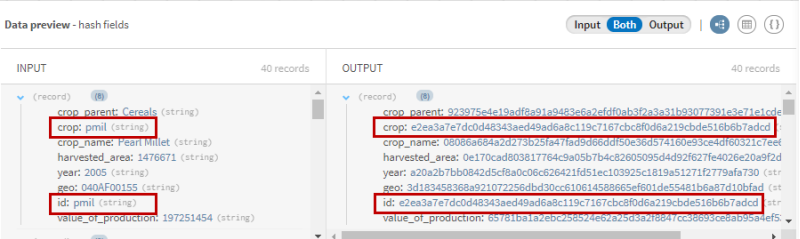

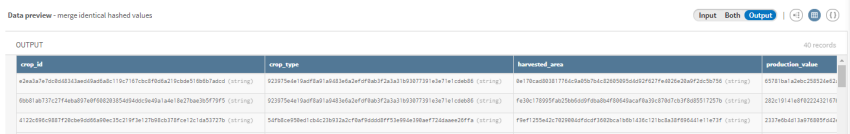

タスクの結果

パイプラインは実行中となり、データはハッシュされ、同一のフィールドは記述した条件に基づいてマージおよび再編成され、出力は指定したターゲットシステムに送信されます。

このページは役に立ちましたか?

このページまたはコンテンツに、タイポ、ステップの省略、技術的エラーなどの問題が見つかった場合は、お知らせください。改善に役立たせていただきます。